「知の品格とは、どれほど多くを記憶しているかではなく、どれほど深く理解しているかである」

10層の純粋、0.01%の誠実。

過学習という誘惑を断ち切った、真の知能。

AIの世界において、正解率を高めることは容易です。モデルを巨大化し、計算力に物を言わせれば、データセットの「癖」さえも丸暗記し、100%に近い数字を弾き出すことができるからです。しかし、それは「知能」ではなく、単なる「模倣」に過ぎません。

MNISTという完成された世界には、約15枚の「誤ラベル」という罠が潜んでいます。この罠を無理に正解しようとすれば、AIは本質を見失い、実社会では通用しない「過学習(Overfitting)」という深い霧の中に迷い込みます。

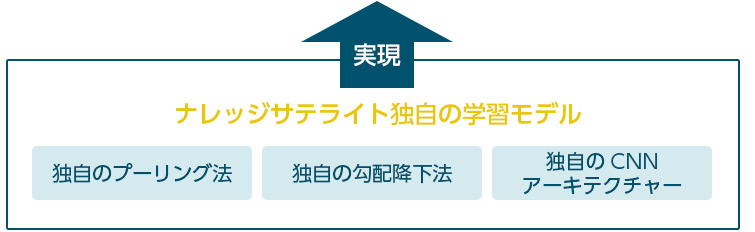

私たちは、あえて層数を12層から10層へと研ぎ澄ましました。この決断は、AIに「ノイズを無視する勇気」を与えるためのものです。10層という究極のバランスが、データの中に紛れ込んだ汚れを鮮やかに見捨て、数字が持つ不変の本質だけを捉えきりました。

この0.01%の差は、単なる数値の更新ではありません。「過学習の壁」の直前で踏みとどまり、ノイズに媚びず、真実だけを射抜く。KSN10は、AIが真の意味で「理解」に到達したことを証明する、もっとも誠実で、もっとも美しい解答です。

『アイデアと・データと・End to End学習による機能開発へ』

※MNIST:Mixed National Institute of Standards and Technology database

モデルを肥大化させれば、精度は上がる。しかし、我々はそれを良しとしなかった。

余分な層を削ぎ落とし、数学的純度を高めることでしか到達できない領域がある。

0.01%の壁を打ち破ったのは、10層という「構造の美」だった。

〒194-0013 東京都町田市原町田6-22-3 ナレッジ201

FAX:042-785-5829

E-mail: info@ knowlsat.jp

©KnowledgeSatellite Inc.